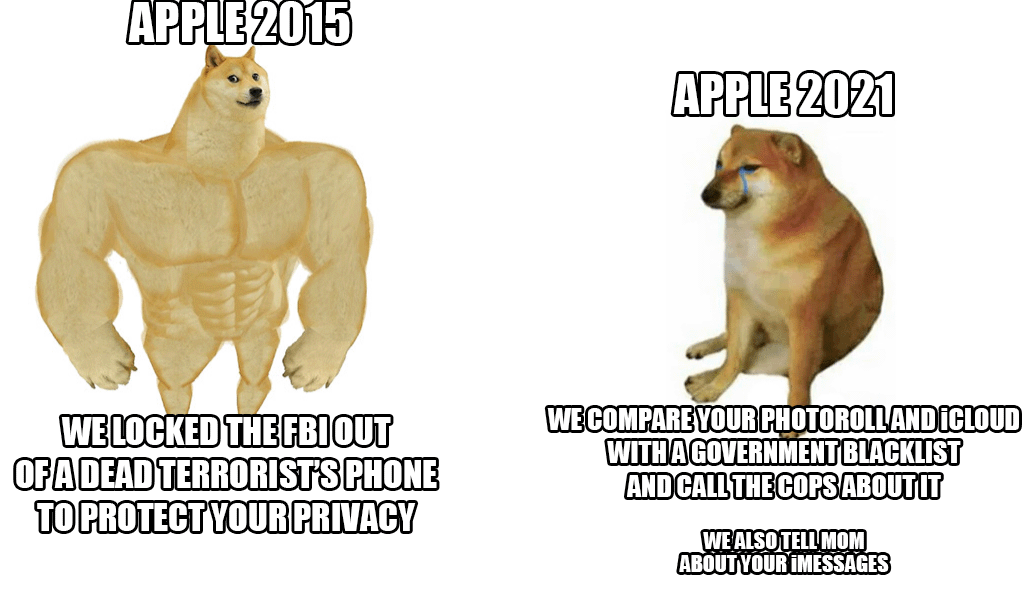

Pagājušās nedēļas beigās Apple iepazīstināja ar jaunu sistēmu pret vardarbību pret bērniem, kas skenēs praktiski ikviena iCloud fotoattēlus. Lai gan ideja no pirmā acu uzmetiena izklausās laba, jo bērni patiešām ir jāpasargā no šīs darbības, Cupertino milzi tomēr kritizēja lavīna - ne tikai no lietotājiem un drošības ekspertiem, bet arī no pašu darbinieku rindām.

Saskaņā ar jaunāko informāciju no cienījamas aģentūras Reuters vairāki darbinieki pauda bažas par šo sistēmu iekšējā saziņā par Slack. Iespējams, ka viņiem būtu jāuztraucas par iespējamu varas un valdību ļaunprātīgu izmantošanu, kuras varētu ļaunprātīgi izmantot šīs iespējas, piemēram, lai cenzētu cilvēkus vai noteiktas grupas. Sistēmas atklāšana izraisīja spēcīgas debates, kurās jau ir vairāk nekā 800 atsevišķu ziņojumu iepriekšminētajā Slack. Īsāk sakot, darbinieki ir noraizējušies. Pat drošības eksperti jau iepriekš vērsuši uzmanību uz to, ka nepareizajās rokās tas būtu patiešām bīstams ierocis, ar kuru tiek apspiesti aktīvisti, viņu jau pieminētā cenzūra un tamlīdzīgi.

Labās ziņas (pagaidām) ir tādas, ka jaunums sāksies tikai ASV. Šobrīd pat nav skaidrs, vai sistēma tiks izmantota arī Eiropas Savienības valstīs. Tomēr, neskatoties uz visu kritiku, Apple stāv par sevi un aizstāv sistēmu. Viņš galvenokārt apgalvo, ka visa pārbaude notiek ierīces iekšienē un, ja ir sakritība, tad tikai tajā brīdī lietu vēlreiz pārbauda Apple darbinieks. Tikai pēc viņa ieskatiem tas tiks nodots attiecīgajām iestādēm.

Tas varētu būt jūs interesē

Es negribētu pārslēgties no iCloud uz kaut ko drošu un patiesi privātu, taču, ja Apple uzstāj, es tik un tā pārtraukšu viņiem maksāt.

Tas būs aktīvs (pagaidām) tikai ASV

Nav īsti svarīgi, kur to piemēros likumdošanā. Šī tehnoloģija jau būs pieejama un ieviesta. Tas ir lielākais risks.